No hay día en que no se nos instruya pastoralmente sobre alguna nueva ventaja de la inteligencia artificial. Gracias a ella, se ha sabido hace poco, el ejército israelí (que no se llama ejército, sino “Fuerzas de Defensa”) ha desarrollado

unos algoritmos que permiten determinar el número de víctimas inocentes (“daños colaterales”) que es lícito provocar cuando se atenta contra un enemigo señalado: no más de 100. Hace poco,

un misil israelí destruyó un edificio entero en una de esas zonas que las propias Fuerzas de Defensa señalan como seguras para los refugiados. Era un “ataque de precisión” en el que, al parecer, mataron a un dirigente de Hamás, así como a otras 90 personas de las que no se sabe que tuvieran culpa de nada, aparte de ser desdichada condición de palestinas. Que fueran solo 90 quizás es una prueba de la mesura de los algoritmos, y también un ejemplo de lo que llaman el Gobierno israelí “respuesta proporcional”.

Como se ve, los crímenes de Estado, a diferencia de los crímenes particulares, vienen siempre adobados de eufemismos: en los años de la

ampulosamente llamada War on Terror, que consistió, sobre todo, en devastar dos países y en dejarlos luego solos y en ruinas con sus talibanes y ayatolás y

sus mujeres…

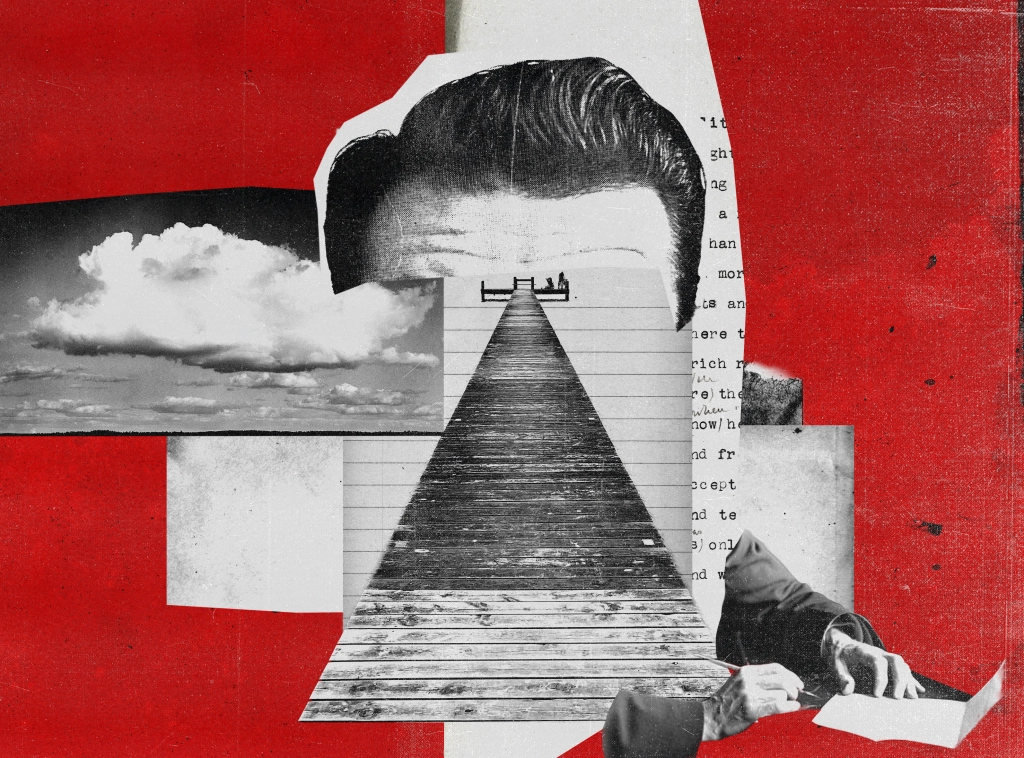

Todo lo que ves aquí no está pensado para complacer. Es para incomodar, remover y dar vueltas a lo que parece evidente. Este espacio no es un premio: es una invitación a mirar con más atención, a escuchar con menos ruido, a quedarse incluso cuando no apetece.

Lo que compartimos en esta parte del sitio no se negocia con algoritmos. Va sin filtros, sin adornos, sin fórmulas. Si llegaste hasta aquí, es porque sabes que hay otra forma de contar. Y de leer.